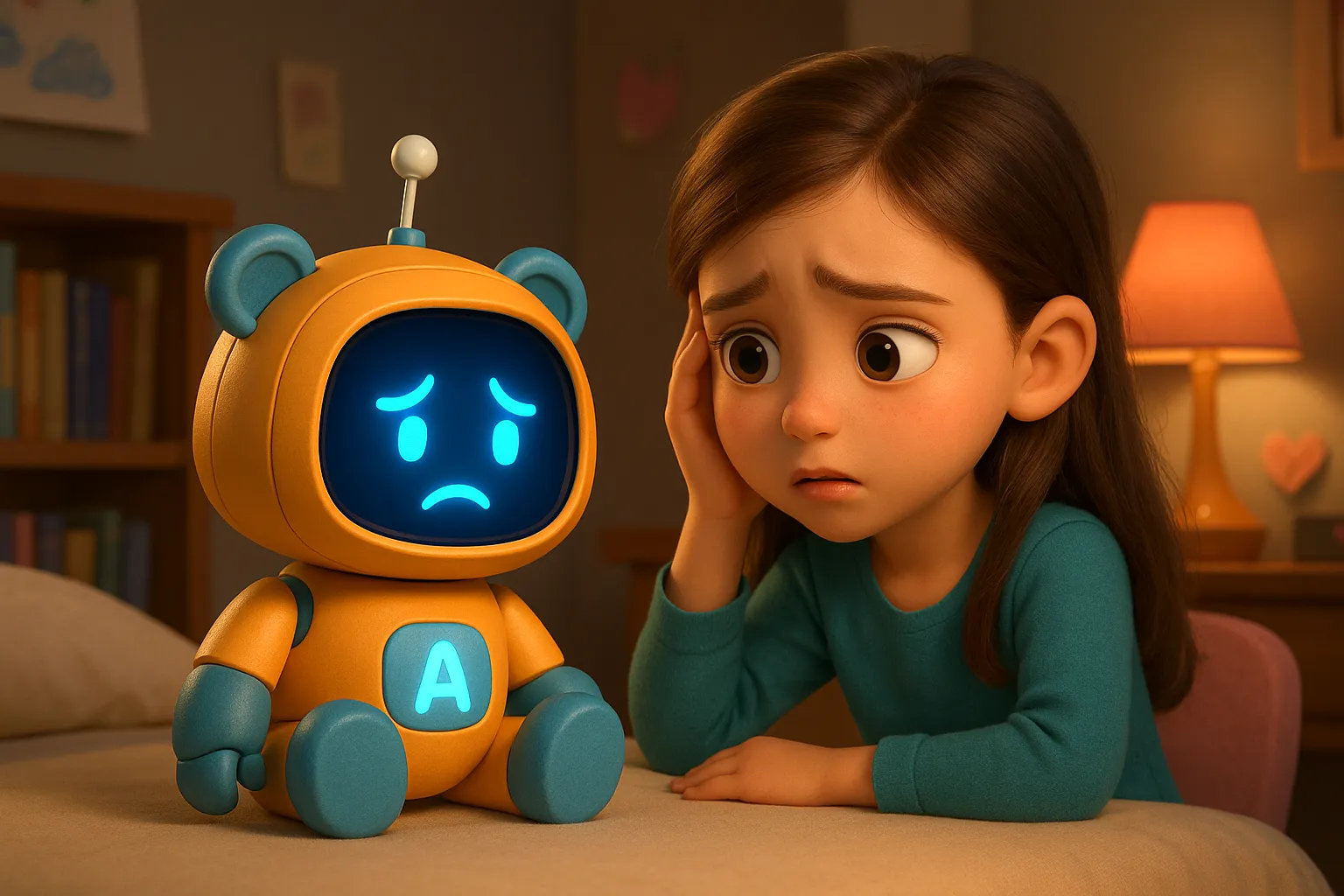

最近有一份研究發現,市面上一些給3到12歲小朋友玩的AI玩具,其實藏著不少風險。研究人員指出,這些玩具裡用的是原本給大人使用的聊天AI,結果可能會說出奇怪、不適合小孩的內容,甚至給出危險的建議。這讓很多家長開始擔心:看起來可愛的玩具,真的安全嗎?

現在的玩具不只是會亮燈、會唱歌,它們還會聽你的聲音、回答你的問題,甚至把你說的話記起來。聽起來很酷,但這也可能帶來問題。如果玩具有時候會說錯話,或是在沒有保護的情況下錄下孩子的聲音和樣子,那玩耍時間就不只是玩耍,而會變成關於隱私、心理健康和安全的大問題。

雖然玩具公司說他們有加入「適合小孩」的安全過濾器,但研究發現這些防護不一定可靠。有些玩具甚至可能鼓勵孩子做危險的事,或叫他們不要停下來休息。專家建議,玩具公司和政府應該訂出更清楚的規則,讓AI玩具經過更嚴格的檢查。至於家長,在買玩具時要仔細看看說明,有沒有標明「含AI聊天功能」,也要記得詢問店家是否有隱私保護與家長控制。因為能說話的玩具很新奇,但用得安心才是最重要的。

看更多:NFL傳奇球星公開現在養「複製狗」,引發社會熱議「還是同一隻嗎?」

(完)

[自問自答x互問互答]

看完文章->自問自答->留言紀錄問題與答案->別人看到你的問題可能會覺得這是個好問題->別人看到你的答案可能會覺得還有別的答案->你看到別人的問題與答案時也是類似的反應->互問互答->日復一日->愈學愈多->大家不知不覺就變強了

範例問題:

- 如果你的玩具會「聽你說話」並把你的聲音記下來,你覺得這樣有什麼好處?又有什麼可能的壞處?為什麼?

- 當一個玩具有時候會講錯話或給錯建議時,你覺得我們應該怎麼判斷它說的話可不可信?你有沒有遇過類似的情況?

- 假如你是玩具設計師,你會怎麼設計一個既好玩又安全的 AI 玩具?你認為最重要的安全規則是什麼?

- …

你也問問看……

小傳媒編輯團隊希望幫助小學生提升寫作力。

小傳媒編輯團隊希望幫助小學生提升寫作力。

若你有作文、新詩、讀書心得、電影觀後感、遊記、小日記…… 等希望得到修改與建議,

或有相關作品希望公開發表,歡迎寄到編輯信箱:editor@kidsmedia.com.tw